Byla vydána nová verze 9.7 multiplatformní digitální pracovní stanice pro práci s audiem (DAW) Ardour. Přehled novinek, vylepšení a oprav v poznámkách k vydání.

Vývojáři webového prohlížeče Ladybird dnes oznámili, že mění způsob vývoje. S blížícím se vydáním alfa verze přestávají přijímat veřejné pull requesty. Všechny otevřené veřejné pull requesty budou uzavřeny. Tým nedokáže garantovat bezpečnost AI generovaných pull requestů.

OpenLogi (GitHub) je open source náhrada aplikace Logi Options+ pro přizpůsobení myší od společnosti Logitech. Zatím běží pouze na macOS.

Na čem pracují vývojáři webového prohlížeče Ladybird (GitHub)? Byl publikován přehled vývoje za květen (YouTube).

Úřad pro ochranu osobních údajů řeší desítky stížností na jednotné měsíční hlášení zaměstnavatele, které stát spustil počátkem dubna. Systém, jenž má firmám odlehčit od desítek formulářů, nejenže výrazně zatížil jejich účetní oddělení, ale docházelo v něm i k únikům osobních dat zaměstnanců k firmám, kde nepracovali. Podle ministerstva práce a sociálních věcí stála za problémem technická chyba. „Incident se týkal několika stovek

… více »Byla vydána (𝕏, Bluesky) nová verze 22.0.0 open source webového aplikačního frameworku Angular (Wikipedie). Přehled novinek v příspěvku na blogu.

Vim Classic byl vydán ve verzi 8.3. Drew DeVault oznámil tento fork editoru Vim (verze 8.2.0148, tj. těsně před zavedením Vim9 skriptování) v březnu letošního roku. Důvodem forku bylo, že vývojáři editorů Vim a Neovim začali při vývoji využívat LLM.

Open source konference DevConf.CZ 2026 proběhne 18. a 19. června v Brně na FIT VUT. Publikován byl program a spuštěna byla registrace.

Společnost JetBrains uvolnila verzi 2 svého open-source velkého jazykového modelu (LLM) pro vývojáře Mellum.

Probíhá konference Microsoft Build 2026. Microsoft představuje své novinky: kvantový čip Majorana 2, Surface Laptop Ultra a Surface RTX Spark Dev Box s NVIDIA RTX Spark, Intelligent Terminal, Coreutils for Windows (fork Rust Coreutils), AI modely MAI, AI agenta Scout, platformu pro agent-first zařízení Project Solara, …

Sice mě rychlost momentálně nezajímá, ale proč to nezkusit, že(?)…

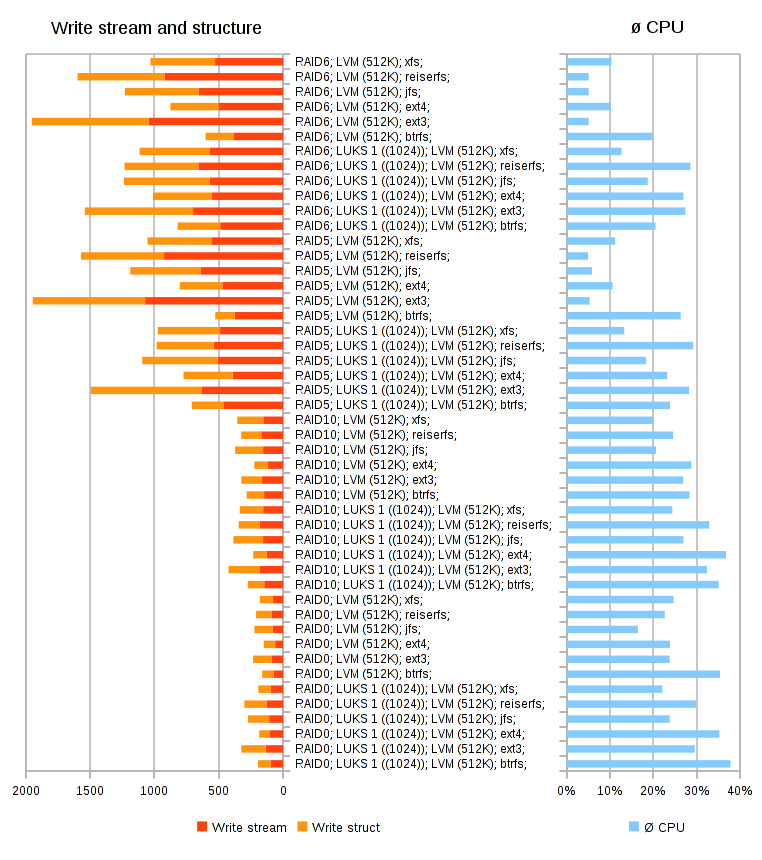

Do srovnání rychlostí kombinací úložiště jsem vložil i LUKS. Pro ty případy, kdy děláte například video či animace s porno záznamem své babičky, nebo třeba děláte nějaké výpočty pomocí MKP (FEM) kde vám to nějaký předpis nařizuje.

Otázkou je jestli by tyto kombinace dalších úrovní (RAID,LUKS,FS) generovaly stejné vzájemné pořadí, kdyby se jednalo o dva(tři, čtyři) SSD disky (nebo takové ty super SSD, co jsem ještě nikdy v ruce neměl, přímo do PCI-E).

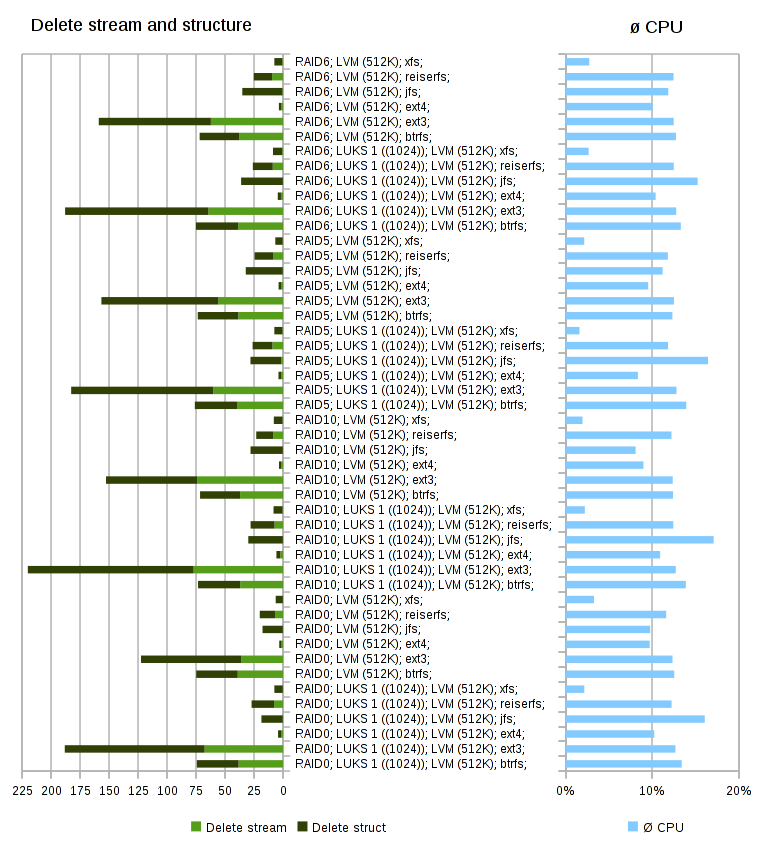

Surový zápis jsem trochu upravil (oflag=sync bs=268435456) celkem 32GiB v 32 souborech. Zapisují se předpřipravená (u)random data (1GiB v souboru v paměti na /dev/shm/). Provedl jsem i mazání pomocí find -type f -delete, pak je ještě smazána struktura již pomocí rm, v čase je zahrnutý i sync.

Struktura celkem obsahuje 223 adresářů a 22000 souborů celkem ≈25.5GiB v tříúrovňové struktuře.

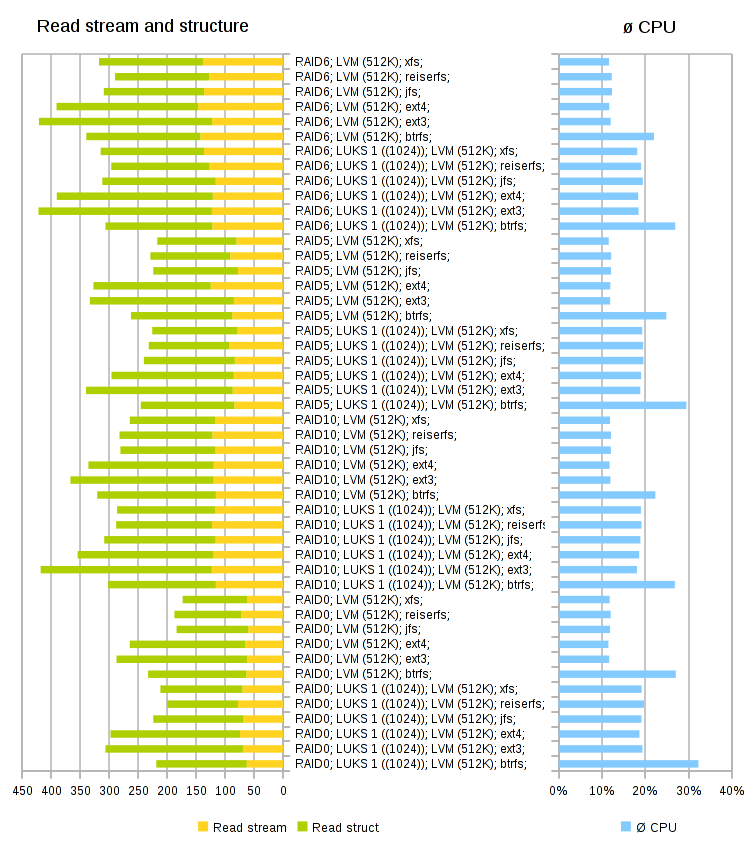

Čtení struktury je podobné jako mazání ted: find -type f -exec dd if={} of=/dev/null bs=268435456

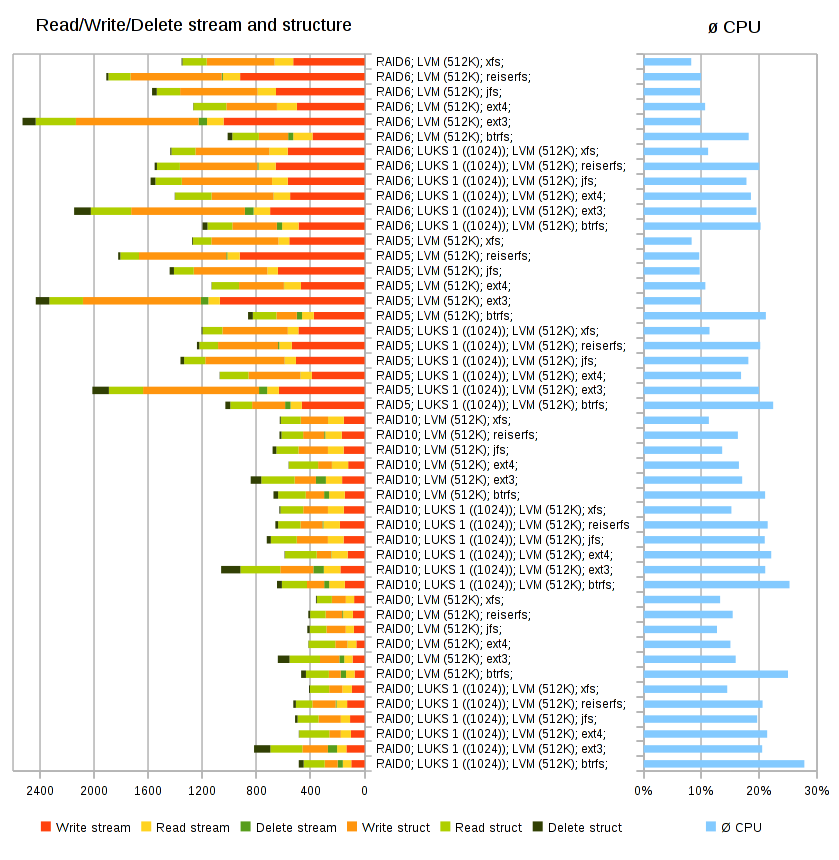

Jako obvykle uvádím i ø vytížení CPU v % (v přílohách je to někde ×10), hodnoty jsou dobou trvání testu, tedy čím menší tím lepší.

V textu uvedu jen 4 grafy (jednotlivé nechávám v přílohách). Grafy jsem tentokráte neseřadil, minule byla námitka a možná je to tak i lepší.

Zde je odkaz na poslední graf setříděný dle času/rychlosti (rovněž je v příloze a v příloze je i dle CPU). Přece jenom na něco je to dobré…

Závěr:

Takovéto informace nejsou potřeba zas tak často, protože rychlost ustupuje jiným kritériím. Ale je spousta aplikací, kde o tu rychlost jde až v prví řadě a pokud máte na výběr z několika možností, tak se to může hodit, minimálně k tomu, aby se na základě toho provedl konkrétní aplikační test.

Pokud máme rychlé úložiště a jde nám o nenáročnost či rychlost, tak s btrfs si to musíme rozmyslet, přece jenom si z toho CPU docela dost ukrajuje, nevím jak by to dopadlo kdyby se použil btrfs RAID0…

Jinak xfs se zdá jako dobrá volba pro nenáročný a rychlý FS ve většině případů (ale ext4 není o mnoho náročnější). Každý si tam musí najít své…

Poznámka k brtrfs a jfs:

Jak jsem zmiňoval, v minulé „hrátce“, jedná se o CentOS 6.4 a jádro 2.6.32, tedy žádná novinka.

btrfs:

Všiml jsem si, že se za stejných okolností chová jinak, tedy přesněji podařilo se zapsat vždy trochu jiné množství dat.

Po skončeném zápisu s hlášením, že už tam neni více místa jsem dostal na df:

/dev/sdf1 22024192 19594732 377140 99% /root/testKdyž jsem chvilku počkal a zkusil dopsat:

dd if=/dev/zero /root/test/kukZapsalo se 717 kB a výpis přes

df vypadal takto:

/dev/sdf1 22024192 19972932 204 100% /root/testVíce už nešlo, ale obě čísla „free“ se u opakovaného stejného testu lišila, druhé nepatrně a první lítalo zhruba od 200000 do 390000.

btrfs jen vypsala:

ERROR: 'nějaká hláška vztahující se k příkazu' - Inappropriate ioctl for device…tak nevím, zkoušel jsem přijít na to kdy-jak-co, ale jediné co jsem zjistil, že se mi to stane jen někdy a to, když bezprostředně po vytvoření jej zaplním…

jfs:

Kombinace RAID5/6→LUKS→LVM→jfs (RAID6 i bez LUKS) po testu (zápis velkých dat, přečtení, smazání, zápis struktury, přečtení, smazání) na umount vykouzlilo doslova BSOD, černý terminál zmodral, umřelo to a restartovalo se to bez jakéhokoliv hlášení jak do terminálu, tak do logu.

Trochu jsem to analyzoval, ale pak jsem se na to vykašlal, je to moc na dlouho, došel sjem jen k tomu, že musí před tím na zařízení (RAID nebo LUKS) existovat FS btrfs a reiserfs, na který se něco zapíše smaže, a odmontuje se (asi jde o to, že se natáhne modul) nevím jestli oba nebo jen některý. Následně před vytvořením jfs se zapíše (nutná podmínka): dd if=/dev/zero of=zařízení bs=512 count=2048, pak se vytvoří jfs, něco se zapíše/smaže provede se vyprázdnění cache sync && echo 3 > /proc/sys/vm/drop_caches && sleep 1, promaže se to přes rm, provede se sync - opět nevím co všechno je nutné,... no a na umount „bác“.

Kombinace roztodivná, a těžko se přihodí, ale při testování to tak náhodou vyšlo a něco tam je zhnilého (může to být klidne „experiemtální“ modul btrfs, těžko říct).

Glosa na závěr: Je „fakt“, že zkušenost z dávné minulosti a z uživatelského hlediska, co šlo z IBM(AIX) bylo pocitově a výkonově horší, než co šlo s SGI(IRIX), a proto SGI(IRIX) skončil…

Tiskni

Sdílej:

![]()

![]()

![]()

![]()

![]()

![]()