Byla vydána nová verze 9.7 multiplatformní digitální pracovní stanice pro práci s audiem (DAW) Ardour. Přehled novinek, vylepšení a oprav v poznámkách k vydání.

Vývojáři webového prohlížeče Ladybird dnes oznámili, že mění způsob vývoje. S blížícím se vydáním alfa verze přestávají přijímat veřejné pull requesty. Všechny otevřené veřejné pull requesty budou uzavřeny. Tým nedokáže garantovat bezpečnost AI generovaných pull requestů.

OpenLogi (GitHub) je open source náhrada aplikace Logi Options+ pro přizpůsobení myší od společnosti Logitech. Zatím běží pouze na macOS.

Na čem pracují vývojáři webového prohlížeče Ladybird (GitHub)? Byl publikován přehled vývoje za květen (YouTube).

Úřad pro ochranu osobních údajů řeší desítky stížností na jednotné měsíční hlášení zaměstnavatele, které stát spustil počátkem dubna. Systém, jenž má firmám odlehčit od desítek formulářů, nejenže výrazně zatížil jejich účetní oddělení, ale docházelo v něm i k únikům osobních dat zaměstnanců k firmám, kde nepracovali. Podle ministerstva práce a sociálních věcí stála za problémem technická chyba. „Incident se týkal několika stovek

… více »Byla vydána (𝕏, Bluesky) nová verze 22.0.0 open source webového aplikačního frameworku Angular (Wikipedie). Přehled novinek v příspěvku na blogu.

Vim Classic byl vydán ve verzi 8.3. Drew DeVault oznámil tento fork editoru Vim (verze 8.2.0148, tj. těsně před zavedením Vim9 skriptování) v březnu letošního roku. Důvodem forku bylo, že vývojáři editorů Vim a Neovim začali při vývoji využívat LLM.

Open source konference DevConf.CZ 2026 proběhne 18. a 19. června v Brně na FIT VUT. Publikován byl program a spuštěna byla registrace.

Společnost JetBrains uvolnila verzi 2 svého open-source velkého jazykového modelu (LLM) pro vývojáře Mellum.

Probíhá konference Microsoft Build 2026. Microsoft představuje své novinky: kvantový čip Majorana 2, Surface Laptop Ultra a Surface RTX Spark Dev Box s NVIDIA RTX Spark, Intelligent Terminal, Coreutils for Windows (fork Rust Coreutils), AI modely MAI, AI agenta Scout, platformu pro agent-first zařízení Project Solara, …

get_all_articles.py vám stiahne z Wikipedie všetky názvy slovenských článkov.LANGUAGE = "sk"

a do main_categories stačí vložiť názvy kategórí z hlavnej stránky Wikipedie v danom jazyku.cat list/list.txt | wc -l 215128

sort list/list.txt | uniq -c | sort -nr | head

545 Imagine_Peace_Tower

189 Super_Jamato_(trieda_lodí)

189 Rimava_(rieka)

174 Slaná

165 Sovetskij_Sojuz_(trieda_lodí)

165 Scharnhorst_(trieda_lodí)

165 Jamato_(trieda_lodí)

165 Bismarck_(trieda_lodí)

163 Šinano_(lietadlová_loď)

157 Cirocha

Možno existuje nejaké elegantnejšie riešenie pre stiahnutie článkov z Wikipedie, ale neviem o ňom.

Takže som si extrahoval len unikátne názvy:

awk '!seen[$0]++' list/list1.txt > list/list-uniq.txtPočet jedinečných článkov je v skutočnosti 15723.

cat list/list-uniq.txt | wc -l 15723

download.py.

Všetky články sa sťahujú do priečinku articles. Ak sa z nejakého článku nepodarí extrahovať text,

tak sa zaloguje do errors/error_save_article.txt. (články sa u mńa práve sťahujú)echo Dom | ./majka -f w-lt.sk.fsa dom:k1gInSc1 dom:k1gInSc4 dom:k1gInSc5 dom:kATo nám to vypľuje, že je to Substantivum, rod mužsḱý neživotný, číslo jednotné v páde 1, 4 a 5. Do ľudského jazyka si to dekódujete pomocou tejto nápovedy.

Ale napríklad sa dá vyskúšať

miniature GPT

, LSTM, alebo čo vás napadne.

Najviac sa tešim, že by to mohlo celkom dobre fungovať, so slovnými druhmi + LSTM a nejaké hranie sa s tým.

Momentálne mám v pláne iné veci, ale chcel som si pripraviť aspoň nejaké dáta.

Ale napríklad sa dá vyskúšať

miniature GPT

, LSTM, alebo čo vás napadne.

Najviac sa tešim, že by to mohlo celkom dobre fungovať, so slovnými druhmi + LSTM a nejaké hranie sa s tým.

Momentálne mám v pláne iné veci, ale chcel som si pripraviť aspoň nejaké dáta.

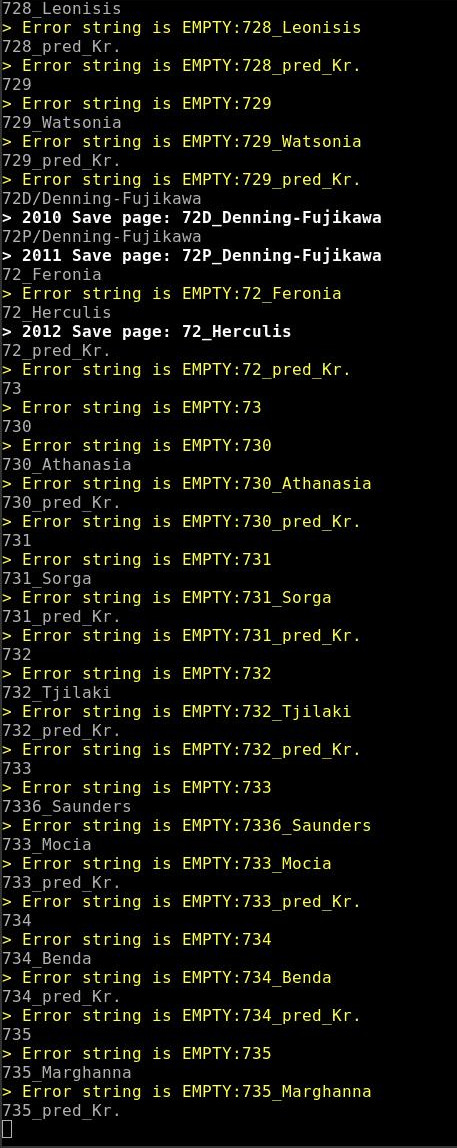

get_all_articles_special.py a stiahol 307149 názvov strániek. Na záver sa zacyklil , takže som skript musel vypnúť ručne. Nemajú to vyvhytané, pretože posledná stránka sa opakuje stále dookola. Teraz sa stánky sťahujú, mno kopec z nich sú obsahovo prázdne, ako je vidieť na obrázku nižšie.

Tiskni

Sdílej:

![]()

![]()

![]()

![]()

![]()

![]()

To je najlepšie.

Stiahneš: stiahneš

Výpis a spracovanie (nič extra ťažké): wiki.openzim.org/wiki/Zimlib

bliká to jako když vomylem máčknu banner s čínskou reklamou :O :O :D ;D

nóó tak vod nás angelinu pozdravuj :D ;D

Na záver sa zacyklil , takže som skript musel vypnúť ručne. Nemajú to vyvhytané, pretože posledná stránka sa opakuje stále dookola.Majú vychytané. Viď poslednú stránku toho zoznamu.

Teraz sa stánky sťahujú, mno kopec z nich sú obsahovo prázdne, ako je vidieť na obrázku nižšie.Ak dáš tie a la prázdne stránky editovať, tak zistíš, že nie sú prázdne. Máš označené, že prázdná stránka, ale tá stránka má a la užitočný text pre používateľa (myslený text vľavo v článku).

na nvidii nejlíp :D ;D

Mno jelikoz ses evidentne debil, kterej neumi stahnout databazi, a pripadne si ji nalejt do vlastni instance mediawikiNechcem si inštalovať softvér ktorý nebudem používať. Uvítal by som klasické zipko všetkých stránok. Niečo som dal teraz sťahovať, ale netuším čo v ňom bude (https://dumps.wikimedia.org/backup-index.html). Inak používam knižnicu, ktorá používa officiálne Wikipedia API, takže to robí trafic medzi 50 - 100kbit/s. To robím väčší DDOS, keď si pustím niečo na YT. 99% požiadaviek aj tak vybaví keš.

).

Nicmene, porizeni/sestaveni vhodnych vstupnich dat je asi nejslozitejsi cast vsech AI projektu. Takze je jasne, ze na tom nejaky cas stravis.

).

Nicmene, porizeni/sestaveni vhodnych vstupnich dat je asi nejslozitejsi cast vsech AI projektu. Takze je jasne, ze na tom nejaky cas stravis.