Byla vydána nová verze 9.7 multiplatformní digitální pracovní stanice pro práci s audiem (DAW) Ardour. Přehled novinek, vylepšení a oprav v poznámkách k vydání.

Vývojáři webového prohlížeče Ladybird dnes oznámili, že mění způsob vývoje. S blížícím se vydáním alfa verze přestávají přijímat veřejné pull requesty. Všechny otevřené veřejné pull requesty budou uzavřeny. Tým nedokáže garantovat bezpečnost AI generovaných pull requestů.

OpenLogi (GitHub) je open source náhrada aplikace Logi Options+ pro přizpůsobení myší od společnosti Logitech. Zatím běží pouze na macOS.

Na čem pracují vývojáři webového prohlížeče Ladybird (GitHub)? Byl publikován přehled vývoje za květen (YouTube).

Úřad pro ochranu osobních údajů řeší desítky stížností na jednotné měsíční hlášení zaměstnavatele, které stát spustil počátkem dubna. Systém, jenž má firmám odlehčit od desítek formulářů, nejenže výrazně zatížil jejich účetní oddělení, ale docházelo v něm i k únikům osobních dat zaměstnanců k firmám, kde nepracovali. Podle ministerstva práce a sociálních věcí stála za problémem technická chyba. „Incident se týkal několika stovek

… více »Byla vydána (𝕏, Bluesky) nová verze 22.0.0 open source webového aplikačního frameworku Angular (Wikipedie). Přehled novinek v příspěvku na blogu.

Vim Classic byl vydán ve verzi 8.3. Drew DeVault oznámil tento fork editoru Vim (verze 8.2.0148, tj. těsně před zavedením Vim9 skriptování) v březnu letošního roku. Důvodem forku bylo, že vývojáři editorů Vim a Neovim začali při vývoji využívat LLM.

Open source konference DevConf.CZ 2026 proběhne 18. a 19. června v Brně na FIT VUT. Publikován byl program a spuštěna byla registrace.

Společnost JetBrains uvolnila verzi 2 svého open-source velkého jazykového modelu (LLM) pro vývojáře Mellum.

Probíhá konference Microsoft Build 2026. Microsoft představuje své novinky: kvantový čip Majorana 2, Surface Laptop Ultra a Surface RTX Spark Dev Box s NVIDIA RTX Spark, Intelligent Terminal, Coreutils for Windows (fork Rust Coreutils), AI modely MAI, AI agenta Scout, platformu pro agent-first zařízení Project Solara, …

Architektury unifikovaných shaderů jsou tu s námi již zhruba dva roky, a tak začneme právě v tomto bodě. Společnost NVIDIA po hubenějších letech, kdy se zejména léčila z propadáku jménem GeForce FX 5800, se na sklonku roku 2006 vytáhla a přišla na trh s řešením, které všichni milovali a kupovali doslova „jako vzteklí“. GeForce řady 8800 se i přes vysokou cenu staly miláčkem statisíců hráčů pro svůj extrémně vysoký výkon. Jakoby snad ani nikomu nevadilo, že si karta vyžádala hned dvě PCI Express napájení (doté doby stačilo jedno), nikomu ani nevadilo, že GeForce 8600 a nižší jsou doslova očesané zmetky (do té doby bylo zvykem, že mainstream měl poloviční parametry hi-endu, 8600 dostala jen čtvrtinu shaderů v 8800), protože 320MB GeForce 8800 GTS byla cenově přístupná, i když měla zpočátku problémy se správou paměti a propady výkonu, a GeForce 8800 GTX jasně kralovala všem hrám.

Nic nedokázalo zastavit rozjetý rychlík. NVIDIA stavěla spíše na evolučním vývoji a konzervativním výrobním procesu, a to se jí vyplatilo. Kanadská ATI vsadila na nový 80nm proces u TSMC. Ten se ale zpozdil, navíc v návrhu GPU R600 byly chyby (viz nefunkční UVD) a do toho všeho přišlo zemětřesení jménem „odkoupení ATI firmou AMD“. Od té chvíle nebylo možné Radeon HD 2900 uvést na trh, musely se nejdříve dořešit interní firemní machinace (kdo bude sedět na kterém křesle, co se jmény „ATI“, „Radeon“ atd.) a než se cokoli pohnulo, přišel čínský nový rok a na Taiwanu se tradičně „přestalo na chvíli makat“.

Než se vše podařilo rozpohybovat tak, aby se práce na super-hi-end kartě Radeon HD 2900 XTX, mimo jiné využívající 1 GB GDDR4 pamětí, pohnuly k vítěznému konci a přišla na trh karta, která měla porazit GeForce 8800 GTX, uvedla NVIDIA zrychlený model GeForce 8800 Ultra a to byl konec. AMD mohla tak akorát zatlačit slzu, protože na tu zkrátka nestačili. Místo toho přišlo rozhodnutí neuvést super-hi-end model, ale použít GGDR3, trochu snížit takty, tím zlevnit i výrobu (napájecí obvody, chlazení) a vrhnout na trh Radeon HD 2900 XT s 512 MB GDDR3 za přijatelnou cenu.

Karta to nebyla špatná. Naopak, její výkon byl velmi slušný. Ale na téměř 3/4 roku starou 8800 GTX prostě nestačila, navíc katastrofálně topila a „papala kilowatty“ jako o život. Ostatně, nesla 6+8pin PCI Express konektory, což si mnozí vyložili tak, že s 2×6pin nepojede, nebo pojede špatně. Tak tomu nebylo, ale i tato drobnost pověsti Radeonu HD 2900 uškodila, stejně jako zmatky kolem údajné podpory HD videa. Dnes už nemá smysl pátrat po tom, za co kdo mohl. Podstatné je, že nVidia z tohoto stavu dokázala vytěžit maximum, za což ji magazín Forbes vyhlásil americkou společností roku 2007. Doslova a do písmene se začala topit v penězích, což byl pravý opak AMD. Tuto firmu pak v červenci 2007 opustil jeden z čelních představitelů David Orton, šéf bývalé ATI. Mnozí to vnímají jako důkaz toho, že „krysy opouštějí potápějící se loď“, jiní jako snahu AMD zbavit se posledních ATI-mohykánů na čelních postech firmy. Oficiální odůvodnění zní, že David je unaven, chce se věnovat rodině a zaměřit své aktivity jiným směrem.

Ale kdeže ty letní sněhy jsou. Přišel podzim 2007 a s ním čas zametání těchto nenasytných karet tam, kde končí prach dějin. Před Vánoci nám oba výrobci servírovali vylepšené verze svých GPU, prohnané navíc die-shrinkem. V případě AMD šlo o veleúspěšné Radeony HD 3800, které předvedly něco nevídaného. Za výrazně menší částku (úspora na výrobě GPU, napájecí části, menším chladiči a tak vůbec) přinesly navýšení výkonu oproti HD 2900 XT, navíc díky pouhým pár drobným úpravám pokrokového návrhu R600 dostaly do vínku podporu DirectX 10.1 a také konečně plně funkční hardwarovou akceleraci videa zvanou UVD. Navíc si vystačily pouze s jedním 6pin PCI Express napájením, které ani nevyužívaly naplno. Asi nepřekvapí, že z karet se stal ihned hit, k němuž mimo jiné přispěla i NVIDIA.

Ta sice v uvedla svou 65nm GeForce 8800 GT se 112 stream procesory o měsíc dříve, ale první týdny a měsíce šlo spíše o paperlaunch. Karet bylo doslova jak šafránu a dokonce kolují historky (potvrzené, žádný výmysl!), že když chtěl milý distributor pro ČR získat nějaké ty vysoce nedostatkové GeForce 8800 GT na český trh, musel s nimi vzít i několik vagónů neprodejných GeForce 8600 a maloobchodníci tak byli žádáni, aby masivně propagovali tu či onu značku a pomohli prodat i tyto pomalé kousky.

Takové krvavé podmínky si kladli výrobci grafik, ostatně z pohledu lidí stavících si levné herní mašiny by po kartě, která si již v době uvedení na trh vykoledovala označení „kastrát“, po uvedení GeForce 8800 GT neštěkl ani pes. Do kancelářských sestav možná fajn, ale za dvojnásobek ceny obdobně schopných karet ATI to byla nadále větší a větší katastrofa. Asi se není čemu divit, že počáteční týdny od startu prodeje GeForce 8800 GT se vyznačovaly obrovskými maržemi prodejců, kteří zkrátka potřebovali nějak vykompenzovat nutnost současného odběru neprodejných karet (a samozřejmě se taky trochu zahojit nad rámec slušnosti, svézt se na vlně :-).

Z té doby také pocházejí rekordní prodeje karet ATI (nejen 3800, které přišly měsíc po 8800 GT, avšak byly od začátku dostupné v obchodech, ale i modely 2400 a 2600 se prodávaly výrazně lépe), a to i v České republice, kde si místní zastoupení AMD mohlo po delší době trochu odfrknout, byť je trápila řada jiných problémů.

Krátce před Vánoci 2007 (tedy ve stejné době jako AMD Radeony HD 3800) stihla NVIDIA ještě uvést novodobou GeForce 8800 GTS se 128 stream procesory a 512 MB paměti, jejíž cena, byť stále příjemná, již nevyvolávala takové „davové šílenství“ jako 8800 GT. Dalším počinem bylo únorové uvedení GeForce 9600 GT. Ta přišla s inovovaným GPU G94 využívajícím 64 stream procesorů a díky dobré ceně se stala celkem oblíbenou volbou pro mnohé „méně majetné“ nebo méně náročné hráče.

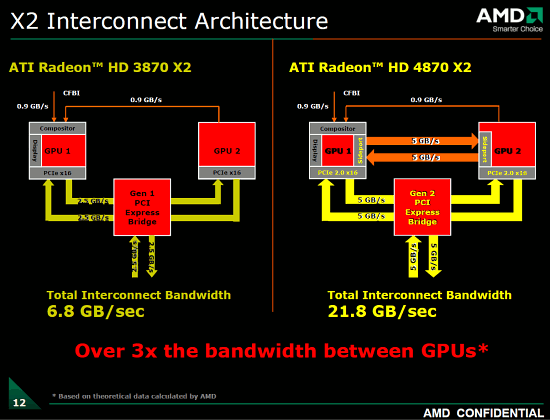

Ve stejné době přišlo AMD s duálním Radeonem HD 3870 X2. A spolu s ním, světe div se, přišlo v nadcházejících měsících na přetřes téma micro stutteringu, u kterého si dovolím krátce se zastavit.

Tento jev se vyznačuje nesouvislým FPS ve hře, které padá na bedra dělení práce mezi dvě GPU. Jde o to, že hra sice vykazuje třeba 60 FPS a měla by tak být zcela plynulá, ale skutečný vjem takový není. Místy totiž běží v desítkách FPS, aby jinde zase krátce spadla hluboko pod hranici plynulosti, vše v důsledku střídání GPU a nedostatečně rychlé vzájemné komunikace na kartě.

Obecné povědomí jakoby pak říkalo, že Radeon HD 3870 X2 trpí micro stutteringem a skoro nikde nezazní, že tento jev je ve větší či menší míře vlastní všem multiGPU řešením, tedy i dvěma GeForce v SLI, třem GeForce v 3-way SLI, čtyřem GeForce v Quad SLI i Radeonům v CrossFire (X). Je to jedna z věcí, která udělala z Quad SLI pomocí dvou GeForce 7900/7950 GX2 absolutně totální propadák, a je to jedna z věcí, kterou budete v jisté míře pozorovat i se třemi GeForce GTX v 3-way SLI.

Problém ale je, že tento jev každý vnímá jinak. Dalo by se to přirovnat k input lagu S-PVA LCD monitorů. Mnozí jej nevidí, ani když je „velký jako Sus scrofa f. domestica“, jiní jej pozorují i v situacích, kdy je zcela minimální. Zkrátka a dobře ano, micro stuttering je problém, ale je to problém všech multiGPU řešení a je pouze na uživateli, zdali si najde hůl a půjde psa bíti (nebo uslyší trávu růst). Každopádně při zapnutém V-sync problém s micro stutteringem mizí, protože se prostě natvrdo zobrazuje daný počet snímků.

Další měsíce se nesly v režii NVIDIE. Ta průběžně uváděla nové modely, ale všechny měly jednu nehezkou pachuť. Jak GeForce 9800 GTX, tak pozdější duální GeForce 9800 GX2 stavěly stále na GPU G92 známém již z GeForce 8800 GT, NVIDIA tak v podstatě pouze přeznačovala karty z 8. generace na 9. a tu a tam příležitostně změnila některý parametr. Nicméně ani to nebylo dost drzé, a tak třeba GeForce 9600 GSO uvedená koncem dubna měla naprosto stejné parametry jako GeForce 8800 GS známá již z počátku roku.

Až do léta žila AMD ve vyšším mainstreamu až hi-endu pouze z prodejů řady HD 3000, která sice stále nelámala rekordy výkonnosti, ale jednalo se o levné rychlé a oblíbené řešení. Všichni čekali na příchod Radeonů HD 4800, které měly namísto 320 stream procesorů nabídnout 480. Bohužel, tedy alespoň co lze soudit podle veselých drbů (a následující odstavec opravdu berte s rezervou jako oddychové veselé čtení), to v AMD při vývoji GPU trochu přehnali.

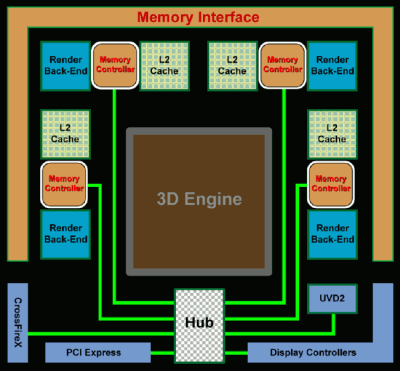

Nový revoluční řadič využívající úsporný hub namísto silně předimenzované prstencové sběrnice a současně provedený die-shrink na menší výrobní proces si vybraly svoji daň. GPU bylo příliš malé! Nedaly se z něj bezproblémově vyvést všechny signálové cesty, nebylo jej jak připojit ke zbytku karty, a tak bylo nezbytně nutné jej zvětšit. Ale jak? Inu, 480 stream procesorů je málo, povýšíme na 800.

V tu chvíli vzaly za své veškeré spekulace na téma výkonu karty a začaly se bořit iluze jako domečky z karet. Reklamní géniové v AMD tentokrát zapracovali na jedničku a vypustili první náhledy na architekturu a výsledky testů ještě před uvedením první karty na trh! I samotné uvedení Radeonu HD 4850 proběhlo dříve, než se původně předpokládalo, a tato grafika ukázala své konkurenci záda absolutně famózním způsobem.

Teprve po příchodu Radeonu HD 4850 na trh bylo možné za trapně nízkých ~3 600 Kč koupit v létě kartu, která utáhla bez potíží při středních detailech většinu her i ve 2560×1600, v 1920×1200 a nižších pak bylo možné nahazovat různé AA/AF režimy nebo zvyšovat detaily. Jedinými dvěma škraloupy na kráse byla vysoká spotřeba ve 2D související se zpočátku nefunkčním PowerPlay a samozřejmě vysoké pracovní teploty dané mimo jiné levným jednoslotovým chlazením. Ale to vše se nedalo než odpustit s ohledem na extrémně nízkou cenu.

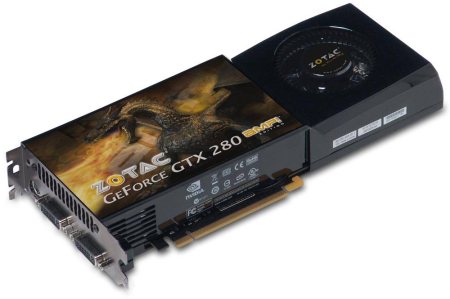

NVIDIA, která krátce předtím uvedla na trh GeForce GTX 280 a posléze GTX 260, mohla pouze se slzami v očích přihlížet, jak tenhle maličký hbitý žralok ukusuje z prodejů stále větší a větší kusy. A začít zlevňovat. Nic nezachránilo ani urychlené „uplácání“ vylepšené GeForce 9800 GTX+. Z velké části se jednalo opět pouze o paperlaunch, ani pár týdnů po jejím ohlášení se tato karta nedala pořádně nikde koupit, zatímco Radeon HD 4850 se prodával jak pálenka za prohibice.

Malá vsuvka: pokud se pohybujete na českých hardwarových fórech, pak jste jistě zaregistrovali osobu jménem no-x, která má v podpisu krásný citát: Igor Staněk [nVidia] po přečtení recenze RV770: "mam pocit, ze je GT200 uplne naprd". To jistě hovoří za vše ;-).

Ve chvíli, kdy se na trhu objevil ještě Radeon HD 4870, bylo „dílo zkázy“ dokonáno a obě GeForce GTX se pár týdnů po uvedení propadly na zlomek svých původních cen, což mimo jiné přimnělo některé výrobce k nevídané akci. XFX a EVGA začali svým zákazníkům, kteří nakoupili za původní vysoké ceny, vracet rozdíl ceny, který za těch pár týdnů dělal i několik tisíc Kč!

Vše završil příchod Radeonu HD 4870 X2. Ten nejenže konečně po letech překonal viditelně konkurenci ve velké řadě testů, ale navíc díky nové architektuře radikálně snížil riziko vzniku micro-stutteringu.

Současný absolutní hi-end tak zastupuje jedno nebo dvě řešení. Záleží na tom, jak se na trh podíváte. Momentálně nelze žádnou kartu prohlásit za absolutního vítěze, který by totálně deklasoval konkurenta ve všech herních i syntetických testech ve všech rozlišeních a všech nastaveních antialiasingu (AA) a anisotropního filtrování (AF).

Obecně se však dá říci, že většina se momentálně shoduje na tom, že nejvýkonnějším řešením na trhu skutečně je Radeon HD 4870 X2. Jde o duální grafiku, která na svém velkém PCB nese hned dvě GPU RV770. AMD používá vlastní specifickou architekturu, silně odlišnou od nVidie, proto nelze jejích celkových 1 600 stream procesorů přímo číselně porovnávat s 240 stream procesory GPU GT200 v GeForce GTX 280.

Ale jedno lze říci přímo: výkonově nabízí ~2,4 TFLOPs v single-precision. Hodnota TDP je stanovena na astronomických 286 W, což z karty činí největšího otesánka dosavadní historie (ale připomínám, že toto je pouze teoretická hodnota, v reálu si grafiky zdaleka neberou tolik, kolik je hodnota TDP).

Vývoj GPU ATI se odebíral velmi progresivním směrem, a tak tato poslední generace umí využívat i nové GDDR5 paměti, které s efektivním taktem 3,6 GHz stačí při 256bitové sběrnici i pro takto výkonné GPU. Dokonce se při uvedení Radeonu HD 4850 (první karta s RV770, využívající přitom taktem pomalejší GDDR3) objevila měření, dle kterých Radeon HD 4850 s 512 MB paměti neztrácel příliš na výkonu ani v Oblivionu s ~2GB Texture Packem (4× přesahujícím paměť grafiky), kde i 1GB karty od NVIDIE již zoufale lapaly po dechu.

Duální model se přitom v 2GB GDDR5 verzi dá pořídit již pod 10 000 Kč, což je ve srovnání s dobou monopolu GeForce 8800 GTX cena takřka nevídaná. Jedinou vadou na kráse z hlediska Linuxu je stále nedokonalá podpora daná zčásti (ne)kvalitou oficiálních ovladačů od ATI a (ne)hotovostí open source ovladačů. Věci se lepší každou chvíli, ale stále to není ono a pošramocenou důvěru linuxové komunity, kterou svou ignorancí a laxností napáchala někdejší kanadská společnost ATI, bude AMD ještě dlouho napravovat. Ale to už je jiný příběh, správně by do hardwarových novin nepatřil, ale musíme si vše napoprvé uvést v kontextu.

Nicméně pro úplnost dodejme, že GeForce GTX 280 je s cenou kolem 9 000 Kč vynikající volbou, pokud preferujete „minoritní operační systémy“. GTX 260 za 5 500 Kč je bezesporu výrazně lépe dosažitelnou volbou s vynikajícím výkonem, prakticky za stejnou cenu pak pořídíte Radeon HD 4870.

Ještě vám dlužím zmínku o GPGPU technologiích, kde NVIDIA svým balíkem CUDA řádně šlape na plyn. Nejenže nabízí vše potřebné pro vývoj aplikací již dlouhou řadu měsíců (stejně jako AMD), ale hlavně postupně rozšiřuje funkčnost směrem k běžným uživatelům. Spolu s řadou GeForce GTX tak přišel na svět i první program Badaboom (v té době časově omezená beta verze primárně určená pro recenzenty) nabízející encoding videa pomocí GPU. Nyní se již ví i o novém TMPGEnc 4.0 Xpress a do budoucna budou podobné nástroje přibývat.

Dalším želízkem v ohni byla velmi dobře načasovaná koupě skomírající společnosti Ageia. Ta stála za fyzikálním systémem PhysX a příslušnými přídavnými kartami. Svojí obchodní politikou si však zadělala na vlastní konec, ceny nasadila příliš vysoko a tak proti Havoku, který běží na CPU, neměla výrazné šance.

NVIDIA před několika týdny tuto firmu koupila, obrátila o 180° a postupem času zprovoznila PhysX počítaný pomocí GPU všem majitelům GeForce řad 8, 9 a GTX zcela zdarma. AMD se naproti tomu „paktuje“ s Intelem, který taktéž před (delším) časem koupil firmu Havok. Tím končíme lekci z historie a pojďme na současnost.

Máme září, tedy měsíc, kdy přijdou na trh Radeony HD 4600 a 4500. Snad neprozradím nic důvěrného, když zmíním, že HD 4600 budou modely s 320 stream procesory, které budou pracovat se 128bitovou paměťovou sběrnici, ale hlavně: vystačí si s napájením z PCI Express slotu! Jinými slovy výkon někde kolem Radeonu HD 3850 (spíše nad ním, vyčkejme však nezávislých testů), ale s minimální spotřebou (TDP bude pod 75 W).

Radeony HD 4500 si budou muset vystačit se 120 stream procesory (nástupci HD 3600), ale jejich TDP spadne na směšně malých méně než 25 W. Do toho všeho se ještě objeví Radeon HD 4850 s GDDR3 pamětmi, který by měl při nižších frekvencích dávat něco kolem 2 TFLOPs při TDP ~230 W. Jeho cena bude ještě příznivější než u HD 4870 X2.

NVIDIA také kutí pod pokličkou. Pokud pomineme ne moc zajímavé karty z low-end segmentu, tak se všichni jistě těší na die-shrink GPU GT200, který kromě potenciálu pro výrazně levnější GeForce GTX s nižší spotřebou ukrývá možná i potenciál pro duální kartu, která by to opět výkonově ATI natřela. Ale u NVIDIE je to bohužel vždy vaření z vody, firma zásadně neuvedené produkty nekomentuje. Jediné, co zatím neoficiálně prosáklo, jsou informace o vylepšené GeForce GTX 260, která dostane do vínku místo 192 rovnou 216 stream procesorů. Slušelo by jí tedy spíše označení GTX 270, ale uvidíme, jak bude nakonec vypadat.

Ale pokud bychom přeci jen nahlédli do kotlíku, kde se ta voda vaří, uzříme tam například drby o urychlení přechodu na 40nm výrobu. To se samozřejmě týká ATI stejně jako NVIDIE, obě firmy jsou dvorními partnery TSMC.

Zcela čerstvě se podle všeho prokecla japonská ELSA, dle jejíž prezentace bychom se měli dočkat na přelomu roku 55nm GPU GT206 nahrazujícího model GTX 260 a o pár týdnů později dokonce právě 40nm GPU GT212 nahrazujícího GTX 280. Když se podíváme ještě lépe, pak můžeme výhledově očekávat dvě další technologie, které mají potenciál zahýbat trhem grafik.

První z nich je vícečipové řešení Hydra společnosti LucidLogix Technologies. To slibuje kompatibilitu se všemi existujícími GPU, univerzální čip schopný pospojovat výkon prakticky libovolného množství GPU, aby se celek v operačním systému tvářil jako jedna grafická karta. Hydra současně dává příslib řešení rozložení výpočetní zátěže a eliminace některých nešvarů současných vícečipových řešení. Ale všechno to zní až příliš skvěle na to, abychom tomu bezhlavě uvěřili, dokud to neuvidíme v akci. Nicméně firma to na nedávném IDF předváděla, a to dokonce s grafikami GeForce, takže se mnozí ptají, jak je to s licencí na SLI. Odpověď je jednoduchá: nijak, Hydra nevyužívá SLI, Hydra si sama ošetřuje využití více grafik a operační systém přes ovladače vidí a obsluhuje pouze Hydru.

Druhou zajímavostí je želízko v ohni - co želízko, spíše traverza - v podání Larrabee společnosti Intel. Toto vysoce paralelizované x86 CPU obohacené o další jednotky, včetně velmi výkonného vektorového subsystému, dává příslib univerzálního CPU-GPU řešení nejen pro hry, ale také GPGPU aplikace a vůbec vše, co lze zkompilovat na x86 architektuře. Jediným kamenem úrazu může být softwarově vyvíjený grafický renderer a také fakt, že Larrabee se dočkáme spíše až přespříští rok. A pokud budou AMD i NVIDIA nadále šlapat na plyn jako doposud, může být Larrabee jen průměrným produktem. Hovoří pro něj ale dvě věci:

Od poslední větší výměny vedení v Intelu se již tato společnost podstatně lépe vyhýbá velkým chybám, jako bylo třeba horlivé prosazovaní Netburst architektury. A za druhé, už jen samotný fakt, že povídání o Larrabee věnuje obrovské množství prostoru sám šéf NVIDIE Jen-Hsun Huang, naznačuje, že ho neberou na lehkou váhu.

Pevné disky, optické mechaniky a zdroje.

Nástroje: Tisk bez diskuse

Tiskni

Sdílej:

![]()

![]()

![]()

![]()

![]()

![]()

AMD is in the process of pushing new high-end features into their Linux driver -- such as Multi-GPU CrossFire support -- and with the ATI Radeon HD 4850 they have even begun showing off Tux, the Linux mascot, on their product packaging and providing Linux drivers on their product CDs!inu mám tu dvě retail balení 4850 a ani v jednom nejsou linuxové drivery a CD. a za druhé "in the process" neznamená "dokončili a je to plně a bezchybně funkční". v tomto ohledu nadále zastávám tento názor: dokud neosadím 2x4850 v CF, nenainstaluji ubuntu a nepustím nějakou 3D hru, pak to nepovažuji za hotové. totéž platí i pro ostatní věci (samozřejmě strašně rád napíšu třeba za půl roku, že to amd zmákla a nv se může jít zahrabat

).

).

Např. moje X600 Mobility Radeon se mi umí uspat na disk i do paměti, ale z paměti už ji neprobudím, což je velká škoda.

Např. moje X600 Mobility Radeon se mi umí uspat na disk i do paměti, ale z paměti už ji neprobudím, což je velká škoda.

2D EXA akceleracia 3D OpenGL TexturedVideo hibernacia KDE4 :DPS. s najnovsim fglrx asi tazko rozchodis na R7000. Je to karta ktoru uz AMD/ATI nepodporuje vo svojich ovladacoch (pouzivat treba OSS radeon) rovnako ako nepodporuje stare dobre TNT-Geforce2 nvidia v svojich aktualnych ovladacoch :D

nakonec jsem zrusil dual head (lcd, tv) a pouzil single head (clone mod na tvout) a je to v pohode, system uz zas funguje jak ma.Zajistit, že systém přestane padat, tím, že se vypnou některé vlastnosti, není "funguje, jak má."

v poslednim odstavci kapitoly "Micro stuttering" je preklepDík, opraveno.

mplayer -vo gl:yuv=4:lscale=1

Výkon je s tímto nastavením velice dobrý, na AMD Athlon X2 4850e (2,5 GHz) zvládám přehrávat Full HD (1080p) videa v H264 bez jediného trhnutí (pravda je potřeba trochu upravit nastavení dekódéru (volba MPlayeru -vfm ffmpeg -lavdopts lowres=0:fast:skiploopfilter=all).

Výkon je s tímto nastavením velice dobrý, na AMD Athlon X2 4850e (2,5 GHz) zvládám přehrávat Full HD (1080p) videa v H264 bez jediného trhnutí (pravda je potřeba trochu upravit nastavení dekódéru (volba MPlayeru -vfm ffmpeg -lavdopts lowres=0:fast:skiploopfilter=all).Když už jsme u toho přehrávání FullHD h.264. Nevím co poslední dobou udělali, ale SVN verze Mplayeru(škoda jen, že revize 27573 zrovna nejde přeložit) s použitým demuxerem lavf dovede přehrát právě FullHD h.264 video na mém šrotu(Intel(R) Celeron(R) CPU 2.66GHz s GeForce FX 5200), u kterého normálně předběhne obraz zvuk u zkušebního vzorku o 25 sekund, tak že doběhne obraz se zvukem do konce současně. Teda samozřejmě s -vfm ffmpeg -lavdopts lowres=0:fast:skiploopfilter=all, ale toho si nejde běžným okem všimnout. Zvláště ještě když se škáluje. V akčnějších scénách je sice vidět jak obraz dobíhá, ale něco takového jsem si nepředstavoval ani v nejdivočejších snech.

a mplayer si myslel, že má ~60fps a podle toho to taky přehrál.

a mplayer si myslel, že má ~60fps a podle toho to taky přehrál.

další server , který jde do kytek.Další server, kde neocenili tvé detektivní kvality?

Teda ak pod tym NAS rozumieme to iste (ja ppp koncentrator s autorizaciou klientov na radiuse.

Teda ak pod tym NAS rozumieme to iste (ja ppp koncentrator s autorizaciou klientov na radiuse.

Coreboot byl přesně kvůli takovýmto věcem zamýšlen.

Vim, zlepsuje se to, desek stale pribyva, i moznosti LinuxBIOSu jsou nadstandartni, pokud clovek ma vhodnou desku, muze to byt velmi zajimave reseni...

Vim, zlepsuje se to, desek stale pribyva, i moznosti LinuxBIOSu jsou nadstandartni, pokud clovek ma vhodnou desku, muze to byt velmi zajimave reseni...

Nevím kdo plánuje simulovat každé zrnko písku během výbuchu, těch pár (max. desítech) dnes interagujících objektů zvládne i Athlon.Že by výrobci her?

porovnavate hrusky s jabkam ..... ony gpu maji vykon okolo 1TFLOPS ale v jednoduche presnosti , zatimco u cpu se udava vykon ve dvojite presnosti ....To v tomhle případě klidně můžu, protože pro zmíněné výpočty fyziky ve hrách je jednoduchá přesnost dostačující. Co je mi platné, že CPU zvládne přesnější výpočty, když je nepotřebuju přesně, ale rychle.

+ grafika je silna diky masivne paralelnim vypoctum .....(mnoho "jednoduchych" vypocetnich jednotek) a cpu jedna ...ale velmi komplexni a univerzalni vypocetni jednotka ( u multicore ..2,3,4... atd )Ano, to vím. Nicméně v kontextu této diskuze - no a?

Nyní se již ví i o novém TMPGEnc 4.0 Xpress a do budoucna budou podobné nástroje přibývat.Zrovna včera jsem si v novém

libschroedingerovi všiml volby --with-cuda=PATH. Už jen jak ten bazmek dotunit aby mi nedával tak příšerné výsledky.

Jejich karty jsou nicméně zaměřeny na jiný trh :)a přesně proto jsem je nezmínil

Z té doby také pocházejí rekordní prodeje raket ATI...

nemelo by to byt jinak?